Pensare di essere razionali è una convinzione rassicurante. Ci piace pensare che le nostre decisioni nascano da valutazioni lucide, ordinate, razionali. Che le nostre opinioni siano il risultato di un esame oggettivo dei fatti. Che la logica, in fondo, abbia sempre l’ultima parola. La psicologia cognitiva, e più banalmente la vita quotidiana, ci raccontano qualcosa di diverso.

⟶ Continua a leggere

La mente che non siamo

La mente umana non lavora come un giudice imparziale. Non pesa ogni elemento con freddezza matematica. È piuttosto un sistema adattivo, costretto a orientarsi nella complessità con tempo limitato, informazioni incomplete, pressione emotiva e abitudini sedimentate. Per farlo, il cervello ricorre continuamente a scorciatoie mentali: le euristiche. Non sono un difetto. Sono una risorsa evolutiva. Senza di esse, ogni scelta richiederebbe un’energia insostenibile.

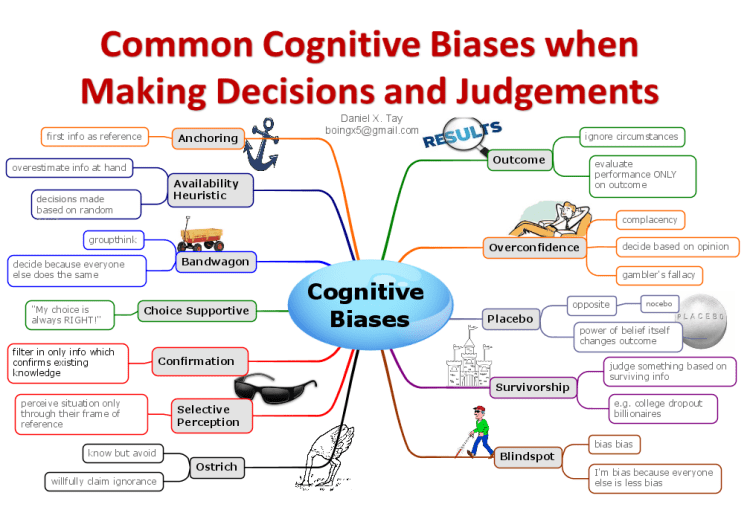

Euristiche e bias, però, non sono la stessa cosa. Le euristiche sono procedure rapide con cui la mente semplifica la complessità per poter decidere; i bias sono le distorsioni sistematiche del giudizio che possono nascere anche dall’uso di queste procedure. In altre parole: l’euristica è spesso il meccanismo, il bias è l’effetto distorsivo che può prodursi.

Il problema nasce quando questi strumenti di economia mentale si trasformano in fonti di errore sistematico. È qui che compaiono i bias cognitivi: distorsioni invisibili che influenzano il modo in cui percepiamo la realtà, selezioniamo le informazioni, interpretiamo i comportamenti e difendiamo le nostre convinzioni. La mente non registra il mondo: lo filtra, lo ricompone, lo ricostruisce. Spesso a nostra insaputa.

Uno dei meccanismi più noti è il bias di conferma: cerchiamo e ricordiamo soprattutto ciò che conferma ciò che già pensiamo, mentre fatichiamo a dare peso a ciò che ci contraddice.

Il bias di disponibilità ci fa giudicare la probabilità di un evento in base alla facilità con cui ci viene in mente: un fatto recente, emotivamente forte o molto ripetuto ci sembra automaticamente più frequente.

L’ancoraggio ci lega alla prima informazione ricevuta, che diventa un punto di riferimento sproporzionato anche quando crediamo di aver corretto il tiro.

C’è poi l’overconfidence, la tendenza a sopravvalutare la correttezza delle nostre valutazioni: la sicurezza si traveste da lucidità, ma non coincide con la verità.

E c’è l’inerzia cognitiva, che ci porta a preferire ciò che conosciamo, anche quando non funziona più, pur di risparmiarci la fatica di rimettere tutto in discussione.

Siamo esseri umani imperfetti, insomma. Ma la questione oggi è più ampia. Perché non viviamo soltanto con i nostri limiti cognitivi: viviamo dentro ecosistemi che li attivano, li amplificano e li sfruttano.

La velocità dei social media, la pressione della comunicazione politica, il marketing dell’attenzione, la polarizzazione del discorso pubblico, l’overload informativo: tutto questo non riduce i bias, li moltiplica. E non è un caso. Questi ambienti non sono neutrali. Sono progettati da qualcuno, con algoritmi e interfacce studiati per catturare il nostro sguardo e mantenercelo incollato, esattamente facendo leva sulle nostre scorciatoie mentali. Il bias di conferma diventa una camera dell’eco. La disponibilità si trasforma in un flusso continuo di cronaca nera e ansia. L’ancoraggio si chiama “prima notizia” dello scroll infinito. Siamo esseri umani cognitivamente limitati immersi in ambienti che premiano la reazione emotiva, l’appartenenza istintiva, la semplificazione.

È sotto pressione, però, che il quadro si fa ancora più netto. Quando il tempo stringe, quando l’incertezza aumenta e le informazioni sono incomplete, le scorciatoie cognitive diventano dominanti. Non decidiamo: reagiamo. Secondo schemi automatici. È per questo che, in molti contesti di rischio, emerge una dinamica ricorrente: una minoranza mantiene lucidità, una minoranza precipita nel panico, e una grande maggioranza resta nel mezzo, esitante, influenzabile, in cerca di segnali da seguire.

Il punto, allora, non è coltivare l’illusione di liberarci del tutto dai bias. Non possiamo. Le distorsioni cognitive sono parte del modo in cui la mente affronta la complessità.

Possiamo però imparare a riconoscerle, a sospettarle e a costruire anticorpi mentali e culturali che ne riducano il potere.

Possiamo rallentare quando possibile.

Possiamo cercare elementi contrari alla nostra ipotesi iniziale.

Possiamo distinguere tra fatti, interpretazioni e intuizioni.

Possiamo esporci a punti di vista diversi.

Ma l’autodifesa individuale, per quanto necessaria, non basta. Perché se i bias sono amplificati da ambienti progettati per trattenerci a tutti i costi, allora la sfida diventa anche collettiva. Le piattaforme che usiamo, i media che consumiamo, gli spazi pubblici in cui discutiamo: tutto questo è disegnato da qualcuno, con obiettivi precisi. Riconoscere i bias significa anche chiedersi chi trae vantaggio dal nostro funzionamento mentale più automatico. E come potremmo costruire insieme ambienti informativi meno manipolativi, più trasparenti, più rispettosi dei nostri tempi e della nostra complessità.

In fondo, la maturità cognitiva non consiste nel credere di vedere il mondo con assoluta chiarezza. Consiste piuttosto nel sapere che il nostro stesso sguardo può ingannarci. Conoscere bias ed euristiche non significa diventare perfetti. Significa imparare a riconoscere le piccole distorsioni con cui la mente semplifica la realtà, e diventare un po’ meno prevedibili nelle nostre illusioni, un po’ meno manipolabili da noi stessi e dagli altri.

In un tempo in cui il rumore cresce più velocemente della comprensione, questa consapevolezza non è soltanto una competenza psicologica. È una forma di autodifesa mentale. Forse anche una piccola disciplina della libertà. Ma perché sia davvero tale, non può restare soltanto individuale: deve saper immaginare anche ambienti collettivi più sani, meno manipolativi, più rispettosi della nostra complessità.

Se il discorso fin qui ha mostrato il quadro generale, il breve repertorio che segue aiuta a riconoscere più da vicino alcune delle euristiche e dei bias cognitivi con cui abbiamo a che fare ogni giorno.

Piccola mappa di bias ed euristiche cognitive

Bias attore-osservatore

Tendenza a valutare in modo diverso cause, qualità e bontà delle azioni a seconda di chi le compie e del tipo di relazione che abbiamo con quella persona.

Euristica affettiva

Quando dobbiamo prendere decisioni automatiche o molto rapide, tendiamo a basarci sulle emozioni che stiamo vivendo in quel preciso momento.

Rilevamento di agenti

Tendenza a presumere, in più di una circostanza, la presenza di agenti esterni, superiori o intenzionali, anche quando non vi sono prove sufficienti.

Bias dello status quo letterario

Distorsione che si innesca quando alcune pubblicazioni omettono o mettono in secondo piano teorie o dati che potrebbero indebolire la validità delle tesi sostenute.

Bias di ancoraggio

Tendenza a valutare caratteristiche, prodotti, prezzi o situazioni in modo distorto perché influenzati dalle prime informazioni ricevute, come cifre, numeri o formulazioni iniziali.

Apofenia

Tendenza a cercare e trovare, in modo erroneo, connessioni o schemi tra elementi che in realtà sono del tutto scollegati.

Attrazione per la novità

Tendenza a considerare un’idea o una proposta come migliore solo perché appare nuova, moderna o diversa dal passato.

Bias dell’attenzione

Tendenza a percepire la realtà in funzione di ciò su cui concentriamo maggiormente la nostra attenzione.

Sostituzione degli attributi

Tendenza a risolvere un problema complesso o a rispondere a una domanda difficile sostituendola inconsapevolmente con una più semplice.

Bias di conferma

Tendenza a cercare, interpretare, favorire e ricordare informazioni che confermano le nostre credenze e i nostri valori, ignorando o ridimensionando quelle contrarie. Questo meccanismo è particolarmente forte quando sono in gioco convinzioni radicate, temi emotivamente sensibili o risultati desiderati. Il bias di conferma non può essere eliminato del tutto, ma può essere gestito con esercizio critico, confronto con ipotesi alternative e attenzione alle controprove.

Bias di congruenza

Caso particolare del bias di conferma: tendenza a verificare soprattutto l’ipotesi iniziale, trascurando di testare seriamente alternative che potrebbero smentirla.

Fallacia della congiunzione

Errore logico che si verifica quando si presume che una combinazione di condizioni specifiche sia più probabile di una singola condizione generale.

Bias della coerenza

Tendenza a restare fedeli agli impegni, alle scelte o alle opinioni precedenti anche quando nuove informazioni suggerirebbero di rivederle.

Pregiudizio di cortesia

Tendenza a esprimere un’opinione socialmente più accettabile rispetto a quella realmente posseduta, per evitare di offendere o creare attrito.

Articoli correlati

- Trappole cognitive: la COGNIZIONE INCONSCIA

- QUANDO L’ANZIANO E’ UN ‘TROLL’ INCONSAPEVOLE e diventa: ..un divulgatore di fake-news

- l’EFFETTO CARROZZONE

- Mediatore? Un Vulcaniano ribelle nel sistema della Mediacrazia

- il BISOGNO di CONOSCENZA … e le nostre decisioni

- MARKETING EMOZIONALE e MARKETING POLITICO … perché nella propaganda politica si parla più di problemi che di soluzioni?

- TRAPPOLE COGNITIVE (parte 1)