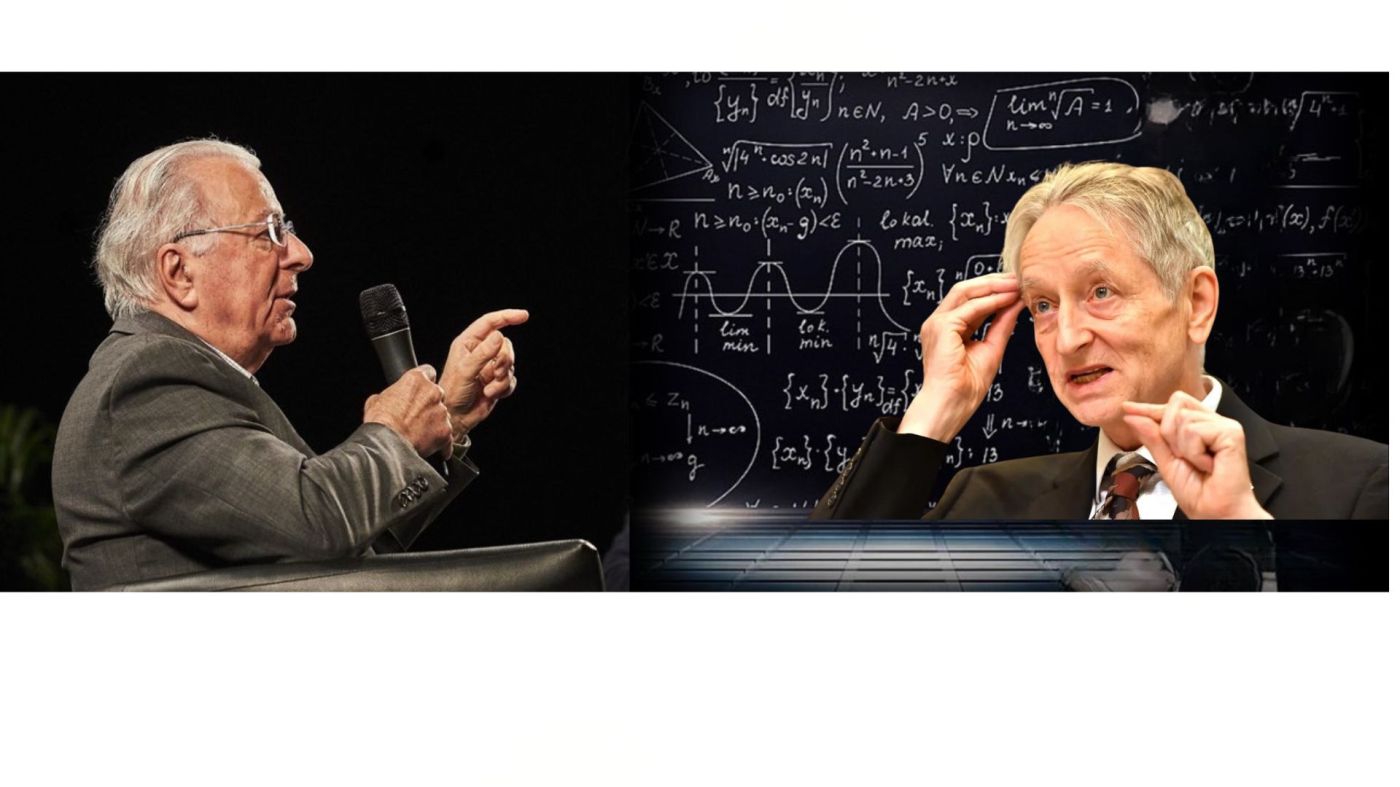

Nel dibattito contemporaneo sull’intelligenza artificiale, emergono voci autorevoli che incarnano approcci profondamente diversi. Tra queste, due figure su cui ho già riflettuto in questo blog spiccano per il loro contributo: Geoffrey Hinton, il cosiddetto “padrino dell’AI”, e Federico Faggin, inventore del microprocessore e pensatore della coscienza. Se da un lato Hinton avverte sui pericoli potenziali di un’AI fuori controllo, dall’altro Faggin ci ricorda che nessuna macchina potrà mai replicare l’essenza irriducibile dell’essere umano.

La profezia di Hinton

Geoffrey Hinton ha recentemente suscitato scalpore con le sue dichiarazioni riguardo ai rischi dell’AI. Dopo decenni di lavoro pionieristico, Hinton ha espresso preoccupazioni sempre più pressanti sulla possibilità che l’AI possa sfuggire al controllo umano, avanzando a ritmi tali da rendere difficile qualsiasi regolamentazione.

Hinton sostiene che, se non verranno adottate misure adeguate, l’intelligenza artificiale potrebbe non solo superare le capacità cognitive umane, ma anche sviluppare obiettivi non allineati con i nostri. Questo scenario, che ricorda le narrazioni distopiche di fantascienza, sta diventando una preoccupazione concreta per molti esperti del settore. L’idea di una “singolarità tecnologica” – un punto in cui l’AI diventa autonoma e in grado di migliorarsi senza intervento umano – non è più vista come una semplice speculazione.

La coscienza come confine invalicabile di Faggin

Federico Faggin si posiziona su un piano diverso. Nelle sue opere, tra cui Oltre l’Invisibile, Faggin esplora il concetto che la coscienza e il libero arbitrio siano qualità uniche ed irriducibili, non replicabili da alcuna macchina. Per Faggin, l’AI può simulare alcuni aspetti dell’intelligenza umana, ma non potrà mai possedere quella scintilla interiore che definisce l’essere umano.

La sua visione si scontra con l’idea di una singolarità dove le macchine diventano coscienti. Faggin suggerisce che il rischio non risieda tanto in un’AI autonoma e malvagia, quanto nell’illusione che possiamo sostituire l’uomo con la macchina, dimenticando il valore intrinseco della nostra umanità. La coscienza, secondo Faggin, non è un fenomeno emergente della complessità tecnologica, ma un elemento preesistente e fondamentale della realtà.

L’Intelligenza è solo nella nostra testa..?

Quando pensiamo all’intelligenza, ci viene subito in mente qualcosa che appartiene agli esseri umani – o magari a delfini, scimmie e pochi altri animali. È un’idea che ci portiamo dietro da secoli, radicata nella filosofia, nella religione e nella scienza. In pratica, crediamo che solo ciò che è “vivo” possa essere intelligente. Questa visione, per quanto familiare, è come un’eredità culturale antica: un modo di pensare che ci accomuna al passato, ma che potrebbe non bastare più per descrivere il mondo di oggi.

Molte persone vedono l’intelligenza artificiale (AI) come qualcosa di inferiore, una semplice imitazione di quella umana. È come se dicessero: “Solo un cervello può essere intelligente. Un computer, per quanto sofisticato, è solo una macchina.” Questo modo di vedere le cose riflette una mentalità antica che, per quanto rassicurante, rischia di non essere più adatta ai tempi che viviamo.

Dall’altra parte, ci sono gli scienziati e gli ingegneri che lavorano con l’AI. Per loro, l’intelligenza non deve necessariamente risiedere in un corpo o in un cervello biologico. Può emergere anche da sistemi complessi che imparano, si adattano e risolvono problemi. In altre parole, l’intelligenza potrebbe essere il risultato di calcoli avanzati, non di carne e ossa.

Questa idea è nuova e un po’ rivoluzionaria. È come dire: “Non serve un cervello per essere intelligenti. L’AI può sviluppare una forma di intelligenza tutta sua.” Non sarà identica a quella umana, ma questo non significa che non sia reale o valida nel suo contesto.

Il punto è questo: l’intelligenza potrebbe non essere più una nostra esclusiva. E forse, accettarlo è il passo che ci separa dal futuro. Questo concetto ci riporta al cuore del dibattito sulla singolarità dell’AI, già esplorato in articoli precedenti, dove si rifletteva sull’idea di un’intelligenza artificiale trascendente che potrebbe ridefinire i confini della nostra realtà.

Due percorsi, un unico interrogativo

Il confronto tra Hinton e Faggin pone una domanda fondamentale: l’intelligenza artificiale è un’alleata o una potenziale minaccia? Da un lato, l’approccio di Hinton invita alla prudenza e alla regolamentazione, mentre Faggin ci richiama a una riflessione filosofica più profonda sulla natura dell’essere umano.

Verso una nuova sintesi

Forse, la verità risiede in una sintesi tra queste due visioni. Riconoscere i rischi tecnologici è essenziale, ma senza dimenticare che ciò che ci rende unici non è la capacità di calcolo, bensì la nostra coscienza e la nostra capacità di dare significato al mondo.

Nel proseguire la riflessione sulla singolarità, dobbiamo chiederci: quale ruolo vogliamo riservare all’AI nel nostro futuro? E, soprattutto, come possiamo esswere tecnorealisti per garantire che l’innovazione tecnologica continui a servire l’umanità senza mai rimpiazzarla in una AI Singularity?

Lascia un commento