In questi ultimi giorni, la decisione dell’Autorità Garante per la Privacy di bloccare gli accessi degli italiani all’uso della ChatGBT elaborato dalla fondazione OpenAI ha fatto molto discutere. In particolare, si è fatto riferimento alla mancata identificazione dell’età degli utenti come uno dei motivi principali alla base di questa scelta.

Ma perché l’identificazione dell’età degli utenti online rappresenta una sfida per le autorità competenti?

E’ importante notare che la protezione dei dati personali e la privacy degli utenti online sono questioni di grande importanza per l’Autorità Garante per la Privacy e che qualsiasi strumento che possa violare questi diritti deve essere valutato attentamente. Uno dei motivi principali è che i minori possono fornire informazioni false sulla loro età o utilizzare account falsi. Inoltre, l’identificazione dell’età degli utenti online richiede spesso l’utilizzo di strumenti che potrebbero violare la privacy degli utenti, ad esempio richiedendo loro di fornire informazioni personali come la data di nascita o l’indirizzo di residenza.

La preoccupazione principale dell’Autorità Garante per la Privacy sembra essere la sicurezza dei giovani online. In particolare, il rischio di bullismo, incitamento al suicidio e incitamento alla violenza rappresentano delle minacce reali per i giovani che navigano in rete. In questo caso, questi rischi sono stati associati a strumenti di intelligenza artificiale come i chatbot, che sarebbero ritenuti poter essere utilizzati per diffondere contenuti inappropriati o pericolosi.

Negli ultimi tempi sta circolando su Whatsapp un nuovo “gioco” pericoloso che sta preoccupando molti genitori e autorità: si tratta di Momo, un’immagine spaventosa di una donna con gli occhi sporgenti e un sorriso sinistro che si dice appaia improvvisamente sui telefoni dei giovani.

Momo funziona in questo modo: il “gioco” comincia con l’invio di un messaggio a un gruppo o a un singolo utente, in cui si chiede loro di aggiungere un numero di telefono sconosciuto. Questo numero sarebbe poi collegato a Momo, che inizierebbe a inviare messaggi agli utenti, spesso contenenti richieste pericolose e provocatorie.Le richieste di Momo possono variare da semplici messaggi provocatori a richieste di compiere atti pericolosi o autolesionistici, come tagliarsi o fare uso di sostanze pericolose. Ci sono stati anche casi in cui Momo avrebbe minacciato di uccidere gli utenti o le loro famiglie.Momo sembra essere diffuso soprattutto tra i giovani, che spesso sono i più vulnerabili a questo tipo di manipolazione. Le autorità sono preoccupate per la diffusione di questo “gioco” e stanno cercando di sensibilizzare i genitori e i giovani sui rischi associati all’interazione con persone sconosciute online e sui pericoli dell’autolesionismo.Inoltre, Whatsapp ha preso provvedimenti per limitare la diffusione di Momo e di altri contenuti pericolosi sui suoi server. L’azienda ha annunciato di aver bloccato il numero di telefono associato a Momo e di aver preso misure per impedire la diffusione di messaggi contenenti la sua immagine. Tuttavia, nonostante queste misure, Momo rimane una minaccia pericolosa per i giovani online. È importante che i genitori e gli adulti siano consapevoli di questa minaccia e che si impegnino a parlare con i loro figli e a monitorare il loro comportamento online. Inoltre, è importante che le autorità competenti monitorino costantemente i siti web e i social network dove Momo e altri contenuti pericolosi vengono pubblicizzati e diffusi, al fine di prevenirne la diffusione e di proteggere i giovani dai rischi associati.

Di conseguenza, il blocco degli accessi a questo chatbot d’intelligenza artificiale è stato visto come una misura necessaria per prevenire questi rischi e proteggere i giovani. .

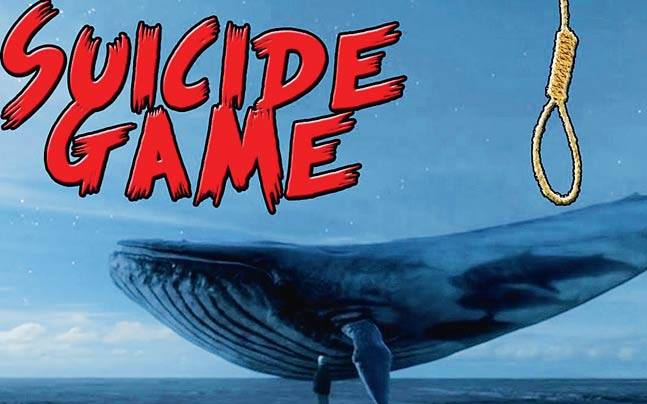

Sebbene sia molto importante continuare a sviluppare soluzioni che possano garantire sia la sicurezza dei giovani online che la protezione della loro privacy, esistono marcate differenze tra pericolosi giochi diffusi online come il Blue Whale Challenge e strumenti di intelligenza artificiale come chatbot GBT.

Anche se sia vero che ci sono alcune similitudini tra la pratica di sfide pericolose come il Blue Whale Challenge e l’uso di strumenti di AI, tuttavia le differenze tra le due cose sono molto marcate. Nel primo caso, infatti, si tratta di giochi che incoraggiano comportamenti estremi e rischiosi, mentre nel secondo caso si parla di strumenti che potrebbero essere utilizzati per diffondere contenuti inappropriati, ma che di per sé non sono pericolosi.

In primo luogo, il Blue Whale Challenge, ad esempio, è stato creato da esseri umani con l’obiettivo di manipolare e danneggiare i giovani. Gli organizzatori del gioco cercano di far sentire i partecipanti soli, isolati e vulnerabili, per poi spingerli ad affrontare sfide sempre più pericolose fino a condurli alla missione finale, il suicidio. In altre parole, il Blue Whale Challenge è una forma di abuso psicologico.

D’altra parte, l’AI non ha emozioni, non ha la capacità di manipolare o danneggiare le persone. L’AI è uno strumento creato dall’uomo per svolgere una serie di compiti specifici, a meno che non sia programmato un algoritmo a tale scopo, cosa che sicuramente non è sicuramente riconducibile agli algoritmi che fanno funzionare l’intelligenza artificiale di Chat-GBT. L’AI può essere usata per migliorare la vita delle persone, ad esempio nel campo della salute, dell’istruzione e dell’assistenza ai disabili.

In secondo luogo, il Blue Whale Challenge coinvolge attivamente esseri umani nel processo. Gli organizzatori del gioco contattano direttamente i giovani tramite i social media e li convincono a partecipare al gioco. L’AI, d’altra parte, agisce solo come uno strumento passivo e non ha la capacità di contattare le persone o di convincerle a fare qualcosa che non vogliono fare.

Inoltre, il Blue Whale Challenge ha un obiettivo distruttivo, mentre l’AI è stato creato per migliorare la vita delle persone. L’AI può essere utilizzata per risolvere una serie di problemi, come la diagnosi medica, la sicurezza informatica e la gestione dei dati.

Infine, è importante sottolineare che l’AI non ha la capacità di prendere decisioni autonome o di agire al di fuori dei parametri che gli sono stati assegnati. L’AI è un mezzo per raggiungere un obiettivo specifico e deve essere programmata in modo tale da rispettare i valori etici e morali della società.

Il Blue Whale Challenge: una sfida mortale

che sta mettendo a rischio la vita dei giovani

Il Blue Whale Challenge, conosciuto anche come gioco della balena blu, è una sfida on-line che da tempo sta facendo preoccupare le autorità di tutto il mondo.

Il gioco prevede una serie di 50 compiti, sempre più pericolosi e autolesionisti, che culminano con l’ultima missione che consiste nel compiere il suicidio.

Questo gioco è stato associato alla morte di numerosi giovani in tutto il mondo, e le autorità hanno lanciato l’allarme per sensibilizzare l’opinione pubblica sui pericoli di questa pratica. Il Blue Whale Challenge è particolarmente pericoloso perché prevede una forte manipolazione psicologica dei partecipanti. I giovani che partecipano al gioco vengono convinti a sentirsi sempre più isolati e alienati dalla società, e a considerare il suicidio come unico modo per uscire dalla loro situazione di disagio.

La natura anonima del gioco e l’uso di internet per organizzare le missioni rendono difficile per le autorità tracciare gli organizzatori del gioco e prevenirne la diffusione. Inoltre, il Blue Whale Challenge prevede una graduale escalation dei compiti, che iniziano con attività apparentemente innocue come guardare filmati horror, ma che diventano sempre più pericolosi e autolesionisti man mano che si prosegue.

Il Blue Whale Challenge ha avuto origine in Russia, ma si è diffuso rapidamente in tutto il mondo, raggiungendo i giovani di ogni continente. È particolarmente diffuso tra i giovani di età compresa tra i 12 e i 18 anni, che sono particolarmente vulnerabili a causa di problemi psicologici o emotivi, come la depressione o l’ansia.

Per prevenire la diffusione del gioco, è fondamentale che gli adulti e i genitori siano consapevoli dell’esistenza del Blue Whale Challenge e vigilino sui comportamenti dei loro figli.

È importante educare i giovani sui rischi di queste pratiche diffuse sul web e su come proteggersi da questo tipo di manipolazione. Insegnare ad adulti e genitori a riconoscere i segnali di allarme, come la tristezza, l’isolamento e la scarsa partecipazione alle attività quotidiane, può aiutare a individuare i giovani che potrebbero essere a rischio di partecipazione a giochi distruttivi.

Ad esempio, i compiti che vengono assegnati ai partecipanti del Blue Whale Challenge includono attività sempre più pericolose e autolesioniste. I giovani sono spinti a fare selfie sui tetti dei palazzi, a guardare filmati horror, a svegliarsi in piena notte per guardare video perturbanti, fino ad arrivare alla missione finale che prevede il suicidio.

Per questo motivo, è importante che genitori e insegnanti siano in grado di identificare i segnali di allarme e di intervenire tempestivamente.

Per prevenire la diffusione del gioco, gli adulti e i genitori devono parlare apertamente con i giovani e chiedere loro se conoscono questo gioco e se sono stati coinvolti. È importante spiegare ai giovani i rischi del gioco e fare in modo che si sentano a proprio agio a parlare dei loro problemi. Inoltre, è importante tenere i dispositivi tecnologici lontani dalla portata dei bambini e dei giovani.

Non meno importante è che le autorità si impegnino a prevenire la diffusione del gioco, monitorando i siti web e i social network dove il gioco viene pubblicizzato e diffuso, con la stessa celerità con cui hanno provveduto a bloccare l’accesso a Chat GBT.

La decisione dell’Autorità Garante per la Privacy di bloccare l’accesso ai chatbot d’intelligenza artificiale, come Chat GBT, sarà sicuramente ritenuta dal garante una misura importante per proteggere i giovani online. Tuttavia, è molto più importante che le autorità competenti adottino tutte le misure necessarie per prevenire la diffusione di giochi on-line come il Blue Whale Challenge e di altri giochi pericolosi, al fine di garantire la sicurezza dei giovani e dei minori in rete.

È inoltre necessario che le autorità siano in grado di identificare i giovani che potrebbero essere a rischio di partecipazione al gioco e offrire loro supporto psicologico e sociale.

Concludendo, sono ovviamente molto sensibile al tema della tutela della privacy in una società che diventa sempre più datacratica. Tuttavia, mi sorge il dubbio che il fenomeno del digital divide culturale – che probabilmente affligge anche il Garante – spesso causa di analfabetismo funzionale, sia la causa di questa draconiana decisione. Sembra che siamo in molti a non riuscire ad individuare delle sostanziali motivazioni tecniche nelle funzioni proprie di ChatGBT per le quali l’uso di questo strumento debba essere vietato in Italia.

Bandito al pari di altre nazioni quali ad esempio la Russia, Iran, Cina e Corea del Nord, dove è stato messo al bando molto probabilmente per altri motivi … Colui che sa usare, capendo come funziona, lo strumento ChatGBT riuscirà forse a percepire qualche altro motivo, probabilmente mascherato ..?