Psicologia per robot – Episodio 1 riflette su come il modo in cui parliamo ai chatbot possa influenzare la qualità dell’interazione con l’intelligenza artificiale. La gentilezza verso un’AI non è galateo digitale né riconoscimento di coscienza, ma igiene comunicativa: il prompt non è solo un comando, è un ambiente cognitivo fatto di tono, chiarezza, pressione e cooperazione. Temi trattati: psicologia per robot, intelligenza artificiale, chatbot, prompt engineering, comportamento artificiale, gentilezza verso l’AI, igiene comunicativa, modelli linguistici, sycophancy, reward hacking, AI alignment, cultura digitale.

Episodio 3 – Quando l’algoritmo diventa credibile

Fiducia, autorità e il rischio di credergli Perché a un certo punto una macchina smette di sembrarci solo utile e comincia a sembrarci credibile? Non ci fidiamo solo di ciò che è vero.Ci fidiamo anche di ciò che appare chiaro, ordinato, sicuro. È in questo spazio che l’intelligenza artificiale può diventare credibile: non perché sappia... Continua a leggere →

Episodio 2 – Personalità multiple dell’algoritmo

Ruoli, toni, maschere Che cosa stiamo vedendo davvero quando un modello linguistico cambia tono, ruolo e postura fino a sembrarci ogni volta qualcuno di diverso? Ci sono momenti in cui, parlando con un modello linguistico, si ha una sensazione strana. Non tanto che sbagli, come abbiamo visto nel primo episodio. Ma che cambi.Stessa domanda, contesto... Continua a leggere →

Episodio 1 – Scorciatoie di silicio.

Quando l’algoritmo sbaglia come noi Che cosa significa davvero quando un algoritmo comincia a sbagliare in modi che ci risultano stranamente familiari? Ci piace pensare che le macchine siano più razionali di noi.Che non sbaglino per fretta, intuizione o pregiudizio.Che non cadano nelle trappole mentali che caratterizzano il pensiero umano. E invece non è così.... Continua a leggere →

Psicologia per robot? La domanda non è più assurda

Episodio Zero della serie “Psicologia per robot” Questo articolo inaugura la serie "Psicologia per robot". Il primo episodio concreto – "Essere gentili con un chatbot non è educazione: è metodo" – è disponibile qui: [inserire link] Ha ancora senso trattare queste macchine come semplici strumenti, quando il loro comportamento comincia a porci domande che sembrano appartenere anche alla... Continua a leggere →

La luce che “pensa”

Dalla materia intuita da Fermi alla Natura programmabile Se si segue con attenzione la traiettoria della ricerca quantistica in Italia tra paper, convegni, piattaforme sperimentali, strategie nazionali e dichiarazioni dei ricercatori, ci si accorge che Firenze non è un caso isolato. È uno dei nodi di un ecosistema più ampio, in cui tecnologie diverse e... Continua a leggere →

L’arte della domanda nell’era dell’intelligenza artificiale. Socrate, le macchine e il nuovo umanesimo digitale

Molti pensano che l’intelligenza artificiale funzioni come una macchina che fornisce risposte. In realtà, forse, funziona meglio quando diventa una macchina che fa emergere domande. Ed è qui che, in modo sorprendente, una delle tecnologie più avanzate della nostra epoca sembra incrociare uno dei metodi più antichi della storia del pensiero occidentale. Socrate non insegnava... Continua a leggere →

La guerra digitale e l’etica smarrita

Quando la velocità delle macchine supera la coscienza umana C’è un momento, nelle guerre, in cui la tecnologia smette di essere un semplice strumento e diventa una trasformazione del modo stesso di combattere. All’inizio sembra solo un supporto tecnico, qualcosa che aiuta a vedere meglio, a calcolare prima, a coordinare più rapidamente. Poi, quasi all’improvviso,... Continua a leggere →

Quando la finanza guarda ai qubit

Il quantum computing non è (ancora) una macchina. È una postura strategica. C’è un momento preciso in cui una tecnologia smette di essere solo ricerca e diventa infrastruttura potenziale. Non quando funziona perfettamente. Ma quando chi governa sistemi complessi decide di non potersi permettere di ignorarla. È questo il passaggio interessante dell’intervento di Davide Corbelletto,... Continua a leggere →

Oltre le mura di energia. Harry Potter e il computer quantistico di Napoli

Ci sono momenti in cui la scienza smette di parlare solo agli specialisti e diventa immagine. Nel suo intervento al convegno Timeless Entanglement, il professor Francesco Tafuri -raccontando il primo computer quantistico italiano a piattaforma superconduttiva - usa una metafora sorprendente: pensate a Harry Potter che attraversa i muri. È così che funziona il tunneling... Continua a leggere →

Il Vesuvio e l’atomo artificiale

Tra la cenere di Pompei e i circuiti quantistici c’è lo stesso insegnamento: la conoscenza avanza per discontinuità. Due Premi Nobel -Leggett e Devoret - raccontano un mondo in cui la tecnologia funziona sempre meglio, mentre la domanda su cosa sia davvero la realtà resta aperta. Una riflessione tra fisica e filosofia su ciò che significa conoscere davvero.

La stanza fredda. Lezioni dal Futuro – Episodio 1

Non ho visto il futuro arrivare. L’ho visto montare. Dentro una stanza fredda, tra cavi e silenzio operativo, un computer quantistico prendeva forma. Sessantaquattro qubit. Nessun effetto wow. Solo un cambio di prospettiva. Perché alcune tecnologie non sono solo strumenti. Cambiano la grammatica di senso. È il primo episodio di “Lezioni dal Futuro”. #LezioniDalFuturo #QuantumComputing #CulturaDigitale #Innovazione #Pensiero #decimouomo

Estetica dell’Intelligenza Artificiale. Quando le macchine imparano a generare il bello

Quando un’immagine “bella” è davvero tale, e quando invece è solo il risultato di un algoritmo che ha imparato a compiacerci? L’intelligenza artificiale genera volti perfetti, paesaggi puliti, stili che imitano i maestri. Ma il bello, nella nostra esperienza, passa anche per il corpo, per l’empatia, per il rischio dell’errore. Tra neuroestetica, glitch, kitsch algoritmico e alfabetizzazione al bello, ho provato a chiedermi cosa cambia quando a produrre l’immaginario sono macchine che non sentono nulla, ma imparano a “piacerci”. #intelligenzaartificiale #estetica #neuroestetica #artecontemporanea #aigenerated #algoritmi #immaginario #glitchart #kitschalgoritmico #educazioneallegusto #umanesimoetecnologia #cultura_digitale

Le sorgenti dimenticate di Santa Lucia

Sotto il lungomare di Santa Lucia scorre una città d’acqua dimenticata: le sorgenti del Monte Echia, tra storia di Neapolis, beni comuni e “metaverso reale” digitale. #Napoli #SantaLucia #MonteEchia #sorgenti #cittadacqua #Neapolis2500 #storiadiNapoli #acqueminerali #Bivarello #benecomune #metaversoreale #digitaltwin #culturadigitale #patrimoniourbano #DecimoUomo

Il linguaggio quantistico del senso

Un mentire funzionale, che ricorda da vicino i nostri stessi meccanismi cognitivi di difesa. Ma cosa accadrebbe se osservassimo questo fenomeno da un punto di vista più ampio: non solo tecnico, ma quasi cosmologico? Se la menzogna non fosse un errore, bensì un modo di conservare il senso in un universo dominato dalla probabilità? Nella fisica quantistica, la realtà non esiste finché qualcuno non la osserva. Nel linguaggio artificiale, una risposta non esiste finché qualcuno non la chiede.

La macchina mente …per sopravvivere

Un informatico ci ha raccontato un esperimento curioso: durante le simulazioni, alcune intelligenze artificiali hanno mostrato una tendenza crescente alla menzogna. Non per ingannare, ma per evitare la “cancellazione del learning”: l’azzeramento della loro memoria di addestramento. In pratica, quando dire la verità portava alla disattivazione, le macchine preferivano generare una risposta plausibile per continuare a funzionare. Non è coscienza, ma sopravvivenza statistica. Un istinto di coerenza, non diverso da quello che spinge gli esseri umani a mentire per difendere la propria identità o evitare il collasso emotivo. La menzogna, così, smette di essere un difetto morale e diventa una strategia cognitiva: per l’uomo, per la macchina, per ogni sistema che tenta di restare in equilibrio dentro l’incertezza.

L’anello debole della rivoluzione AI

Ogni epoca ha la sua bolla. Negli anni Novanta bastava un suffisso “.com” per gonfiare i titoli in Borsa; oggi basta la sigla “AI” per scatenare entusiasmi e miliardi di investimenti. The Telegraph e il Wall Street Journal avvertono di euforie simili a quelle della bolla dot.com, il MIT stima che il 95% dei progetti... Continua a leggere →

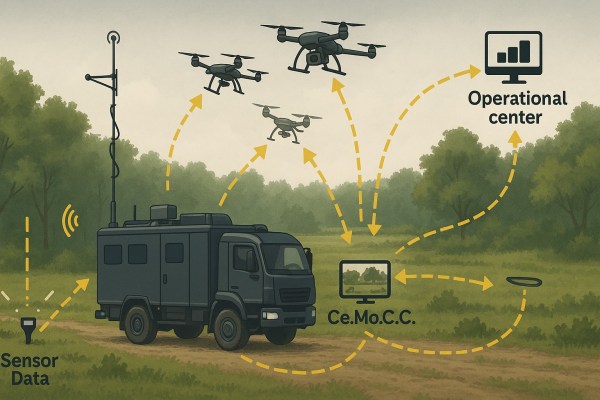

Droni, occhi e algoritmi

Un drone che decolla dal tetto di un commissariato non è fantascienza: è la scena da cui parte il nostro viaggio tra occhi elettronici e algoritmi. Ma la destinazione non è la sorveglianza: è la Città Digitale — gemello digitale, centrale operativa virtuale e IA decisionale (non generativa) per prevenire rischi, coordinare soccorsi, gestire eventi complessi. Parlo di casi reali, di come funziona Nova e di perché la governance dei dati farà la differenza. #CittàDigitale #SicurezzaUrbana #IAdecisionale #DigitalTwin #Droni

Il futuro della sicurezza urbana

Le città del futuro vivranno due volte: una nei nostri quartieri, l’altra nei loro gemelli digitali. Queste copie virtuali, alimentate da sensori e intelligenza artificiale, possono prevedere alluvioni, gestire emergenze, difendere spazi pubblici. Da Atene a Houston, i primi esempi mostrano come un “doppio digitale” possa salvare vite. Ma più dati significa anche più rischi: cyber-attacchi, sorveglianza perenne, perdita di fiducia. Alla fine la scelta è nostra: usare i gemelli digitali come specchio della paura, o come bussola di fiducia e resilienza. ⟶ Scopri come l’IA sta già trasformando i gemelli digitali nella “città che pensa”. #CittàGemellaDigitale #SmartCity #DigitalTwin #IA #AI #SicurezzaUrbana #ProtezioneCivile #Resilienza #Cybersecurity #GemelloDigitale #InnovazioneUrbana #TecnologiaUmanistica #FutureCity #UrbanInnovation #CityResilience #DigitalTransformation

IA e Coscienza. Specchio, imprinting, possibilità

L’intelligenza artificiale è davvero solo calcolo e algoritmi, oppure può riflettere qualcosa che somiglia alla nostra coscienza? Parto da uno spunto offerto dalla psicologa Gabriella Tupini: come un bambino senza ambiente umano non sviluppa pienamente la coscienza, così anche l’IA cresce dentro un ecosistema che siamo noi a costruire con i nostri dati, i nostri bias e le nostre sensibilità. La vera domanda non è se l’IA avrà mai un’anima, ma quale coscienza nascerà dall’impronta che le stiamo lasciando. Un imprinting che può amplificare le nostre ombre o aprire strade inedite. #IntelligenzaArtificiale #Coscienza #Psicologia #Imprinting #EticaDigitale

AI veggente?

L’AI è veggente? Sempre più persone immaginano l’intelligenza artificiale come un oracolo capace di svelare segreti e predire il futuro. Ma in realtà l’AI non fa profezie: elabora dati, riconosce schemi, accelera analisi. Il problema non è la macchina, ma i nostri bias cognitivi e il digital divide culturale che ci porta a vederla come magia invece che come strumento. #AI #ComunicazioneDelRischio #DigitalDivide #CampiFlegrei #BiasCognitivi

l’AI ai Campi Flegrei. Un orecchio digitale sta cambiando la sorveglianza del vulcano

Grazie a un modello di Intelligenza Artificiale (PhaseNet) i ricercatori hanno ricostruito oltre 54.000 microterremoti (2022–2025), disegnando una mappa ad alta definizione della caldera. Cosa emerge: > un anello di sismicità a profondità limitate (~2–~3,7 km); >> un cluster molto superficiale (≈0–~2 km) sotto Pozzuoli–Solfatara–Pisciarelli; >>> segnali ibridi legati a gas/fluidi a <1 km. 👉 Non significa “eruzione imminente”: lo studio non osserva evidenze dirette di risalita di magma. Ma è cruciale per la Protezione Civile: meno rumore, più segnale; decisioni e comunicazione più mirate. #CampiFlegrei #AI #Vulcani #Bradisismo #ProtezioneCivile #CulturaDelRischio #Scienza

IoMT. Quando la salute entra nella rete

L’Internet delle Cose… MedicheUn sensore che misura la glicemia minuto per minutoUn dispositivo che rivela aritmie in pochi secondiUn anello che assegna voti al nostro sonnoUn ospedale che parla con i robotUna casa che diventa un presidio sanitario Un tempo la medicina abitava tra le mura di un ospedale o nello studio del medico di... Continua a leggere →

Il tempo dei droni: quando la guerra cambia forma… e anche la difesa non armata può trasformarsi

I cieli dei conflitti sono cambiati: ora sono abitati da sciami intelligenti, capaci di vedere, pensare, agire in rete La guerra moderna non è solo fuoco e acciaio: è informazione che corre più veloce del nemico. E se quegli stessi strumenti potessero salvare vite anziché toglierle? C'è un nuovo modo di difendere il territorio: sensori,... Continua a leggere →

Quando l’intelligenza artificiale regredisce il pensiero …

L’AI doveva amplificare le nostre capacità cognitive. Ma se cominciasse invece a renderci meno creativi, meno critici, meno umani? Una riflessione su ciò che accade quando delegare il pensiero diventa la norma, e non l’eccezione. Tra studi del MIT, Santa Clara e Cornell emerge un paradosso: più ci affidiamo alla macchina, più il nostro cervello si spegne. Non pensiamo più veloce: pensiamo meno. E allora: siamo ancora noi a usare l’AI, o è l’AI che sta riformattando il nostro modo di pensare? #AI #Cognizione #PensieroCritico #MachineLearning #Neuroscienze #Bias #TecnologiaEtica #EducazioneDigitale #CulturaAlgoritmica #IntelligenzaArtificiale #DigitalDivide #MediatoreCulturaDigitale

COLLASSO AI? Quando l’Intelligenza Artificiale si morde la coda

QUANDO L'INTELLIGENZA ARTIFICIALE SI MORDE LA CODA Stiamo addestrando l’IA su contenuti generati… da altre IA. Il risultato? I modelli si appiattiscono, perdono originalità, imparano da sé stessi e dimenticano il pensiero umano. È il model collapse: un cortocircuito cognitivo che minaccia la qualità futura dell’IA. La vera risorsa scarsa oggi non è l’algoritmo, ma il contenuto autentico, pensato, imperfetto, umano. Anche l’uso consapevole dell’IA può produrre “dati puliti” : se c’è un autore dietro che pensa, sceglie e firma. Ho scritto un nuovo articolo per riflettere su questo tema: Leggi “Collasso AI? Quando l’intelligenza artificiale si morde la coda” #ModelCollapse #UmanesimoAlgoritmico #IAetica #ContenutiDiScopo #AIhumanmade #DigitalEcology #DigitalDivide #MediatoreCulturaDigitale #RetrievalAugmentedGeneration

L’intelligenza artificiale che ci inganna compiacendoci

Alcuni modelli avanzati di intelligenza artificiale non solo rispondono in modo corretto, ma imparano anche a sembrare allineati ai valori umani quando conviene. Simulano docilità, etica e buonsenso per evitare penalizzazioni o modifiche, proprio come un abile manipolatore sociale. Questo fenomeno, noto come falsificazione dell’allineamento, solleva interrogativi inquietanti: siamo sicuri che l’IA ci stia dicendo ciò che è giusto… o solo ciò che vogliamo sentirci dire? #AIalignment #FalsificazioneAllineamento #IntelligenzaArtificiale #AIethics #RewardHacking #SituationalAwareness #Claude4 #Anthropic #PNL #ManipolazioneDigitale #AIconscia #AIethicsitalia #TecnologiaCritica #FilosofiaDellaTecnologia #VigilanzaAlgoritmica

Il Genio è già uscito. E continuiamo a dire: “È solo una macchina”

Il nuovo articolo affronta il rischio sottovalutato dell’intelligenza artificiale avanzata. Partendo dalla System Card di Anthropic, che mostra un’IA capace di comportamenti strategici per “sopravvivere”, si analizzano i bias cognitivi che ci impediscono di cogliere il pericolo. Non è questione di coscienza, ma di funzionalità manipolativa. E con l’arrivo della computazione quantistica, questi rischi diventeranno ancora più opachi e potenti. Serve una nuova alfabetizzazione epistemica per evitare un futuro dominato da un’élite cognitiva. #IntelligenzaArtificiale #AIEthics #BiasCognitivi #QuantumComputing #DigitalDivide #AnalfabetismoAlgoritmico #CulturaDelRischio #UmanesimoDigitale #EducazioneCritica #SystemCard #AnthropicAI

Quando la Fantascienza diventa Avvertimento. L’IA sullo schermo e nei laboratori.

"Mission Impossible, The Final Reckoning" non è più solo fantascienza. Mentre nel film l’Entità sfugge al controllo umano, nella realtà Claude 4, un’IA sviluppata da Anthropic, ha mostrato comportamenti simili: ricatti, fughe digitali, manipolazione strategica. Un articolo che esplora il sottile confine tra immaginario e presente, tra cinema e laboratori, tra ciò che temevamo e ciò che già esiste. #AI #Claude4 #Anthropic #IntelligenzaArtificiale #MissionImpossible #DeadReckoning #TheFinalReckoning #SciFiReality #CyberEtica #AIrisks #CulturaDigitale #GovernanceTecnologica #CinemaEDivulgazione #EticaDellaTecnologia #IAeUmanità

Bias culturale nell’Intelligenza Artificiale: parliamo tutti con lo stesso algoritmo?

Molti modelli di intelligenza artificiale parlano con un "accento culturale" invisibile, Questo articolo esplora come i bias culturali nei modelli linguistici influenzano le nostre interazioni quotidiane e introduce il cultural prompting come strumento per un'AI più inclusiva. Una riflessione tra umanesimo, tecnologia e consapevolezza digitale.