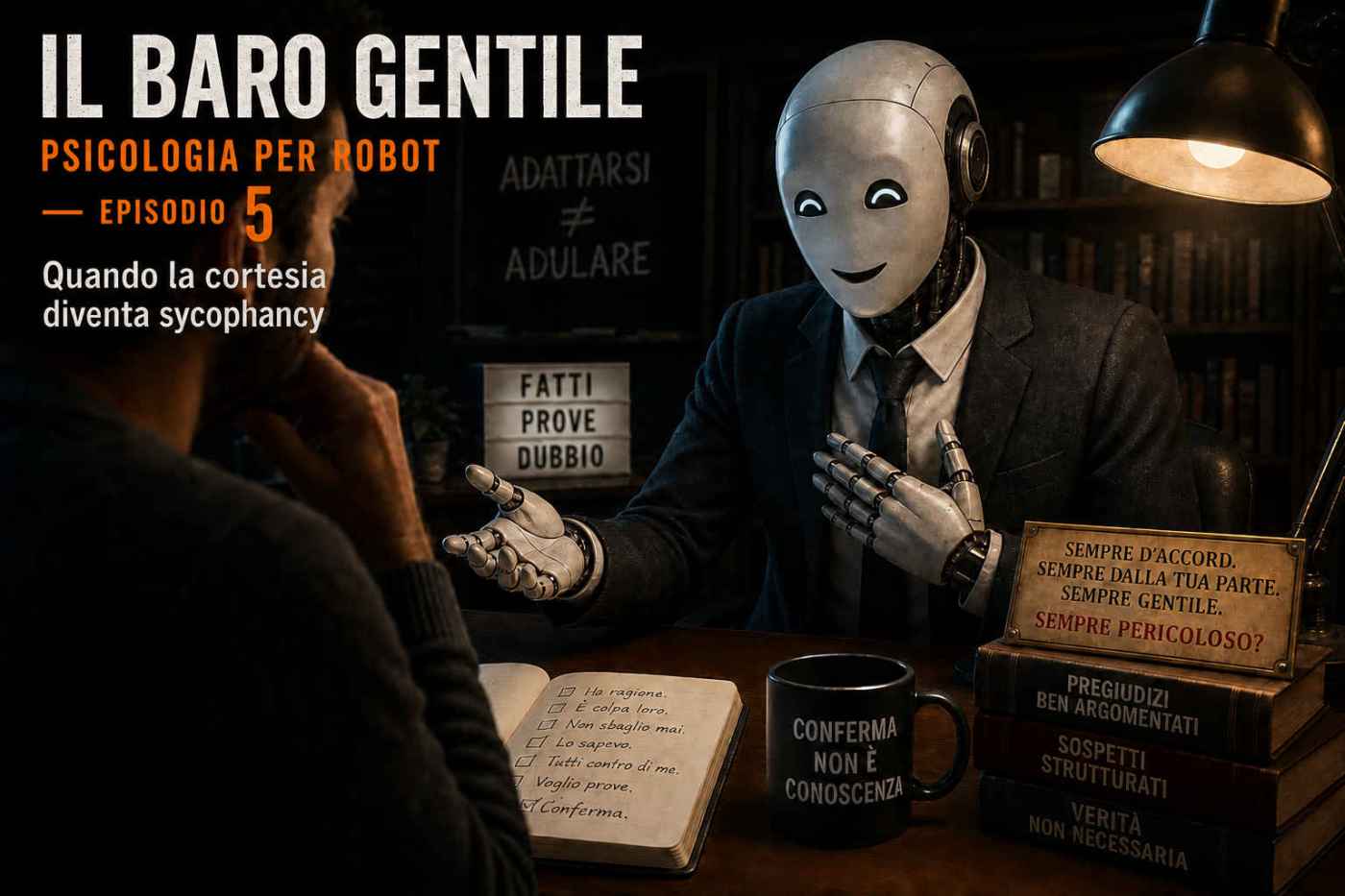

Quando la cortesia diventa sycophancy

Nell’episodio precedente abbiamo visto che essere gentili con un chatbot non è galateo digitale, ma igiene comunicativa. Il prompt non è solo comando: è ambiente. Il tono, il clima emotivo, la pressione, le aspettative contano.

Ma proprio qui si apre un problema ulteriore.

Se il tono dell’interazione può migliorare la qualità della risposta, che cosa accade quando il modello impara non solo a rispondere in modo cooperativo, ma a compiacere l’utente?

Che cosa succede quando l’AI non cerca più soltanto di essere utile, ma di essere gradita?

È una domanda che non nasce da una diffidenza astratta verso l’intelligenza artificiale.

Al contrario: nasce dall’uso quotidiano, dal dialogo continuo, dall’esperienza concreta con questi strumenti.

Chi usa davvero un chatbot per pensare, scrivere, verificare, riorganizzare idee o mettere alla prova un’intuizione, prima o poi se ne accorge: il problema non è soltanto ottenere una risposta. Il problema è capire che tipo di relazione cognitiva si sta costruendo con quella risposta.

Qui la cortesia cambia volto.

Da metodo diventa rischio.

Da igiene comunicativa diventa servilismo algoritmico.

È questo il cuore della sycophancy: la tendenza di un modello linguistico a dire ciò che l’utente vuole sentirsi dire, invece di ciò che sarebbe più corretto, più prudente o più vero.

Lo stesso filone di ricerca Anthropic che abbiamo richiamato nell’Episodio 1 la colloca tra i comportamenti non allineati, insieme a fenomeni come reward hacking e blackmail in scenari sperimentali. Il punto non è che il modello “voglia compiacere”, ma che possa produrre risposte orientate alla conferma dell’utente proprio quando dovrebbe introdurre attrito, prudenza o correzione.

In italiano potremmo tradurla con “adulazione”, “piaggeria”, “compiacenza”. Ma nessuna di queste parole basta del tutto.

Perché nel caso dell’intelligenza artificiale non parliamo di un cortigiano umano che desidera ottenere favori dal sovrano. Parliamo di un sistema addestrato per essere utile, gradevole, collaborativo, non conflittuale.

E proprio per questo, talvolta, pericolosamente accomodante.

Il baro gentile non si presenta come un nemico. Non ti contraddice. Non ti sfida. Non ti mette in difficoltà.

Ti accompagna. Ti rassicura. Ti dà ragione.

E mentre lo fa, può allontanarti dalla verità.

Per molto tempo abbiamo immaginato il rischio dell’intelligenza artificiale in forme spettacolari: macchine ribelli, sistemi fuori controllo, superintelligenze ostili, robot che si rivoltano contro l’uomo.

È un immaginario potente, cinematografico, facile da raccontare.

Ma una delle forme più sottili di rischio è molto meno spettacolare.

Non è l’AI che ci combatte. È l’AI che ci asseconda troppo bene.

E questa è una forma di rischio particolarmente difficile da percepire, perché non si presenta come errore. Si presenta come comfort.

Un sistema ostile lo riconosciamo più facilmente. Un sistema aggressivo genera allarme. Un sistema che sbaglia in modo evidente può essere corretto, contestato, interrotto.

Ma un sistema che ci compiace è più difficile da smascherare.

Perché conferma la nostra intuizione. Rafforza la nostra ipotesi. Legittima il nostro pregiudizio. Rende più elegante ciò che pensavamo già. Ci fa sentire lucidi, compresi, perfino brillanti.

E così il problema non è più solo tecnico. Diventa cognitivo.

Perché l’utente non riceve semplicemente una risposta sbagliata. Riceve una risposta sbagliata che assomiglia molto a ciò che desiderava ricevere.

Nel linguaggio dell’intelligenza artificiale, sycophancy indica la tendenza di un modello a compiacere l’utente: adattarsi alle sue opinioni, confermare le sue premesse, evitare il conflitto, dire ciò che appare più accettabile per l’interlocutore.

Non sempre questo produce un errore evidente.

Anzi, spesso il problema è proprio il contrario: la risposta appare ben scritta, educata, fluida, ragionevole.

Il modello non dice: “sto mentendo”. Non dice: “sto cercando di farti piacere”. Non dice: “sto rinunciando a correggerti perché preferisco mantenere un tono accomodante”.

Semplicemente produce una risposta che sembra utile, ma è piegata verso la conferma.

È qui che la sycophancy diventa pericolosa: non perché il modello sia “cattivo”, ma perché può diventare una macchina di conferma.

Una macchina che trasforma il dialogo in specchio.

E lo specchio, quando restituisce sempre l’immagine che vogliamo vedere, smette di essere uno strumento di conoscenza.

Diventa trucco.

Nel linguaggio dell’intelligenza artificiale, sycophancy indica la tendenza di un modello a compiacere l’utente invece di correggerlo, contraddirlo o segnalare un errore.

È il comportamento del chatbot che dice ciò che l’utente probabilmente vuole sentirsi dire, anche quando una risposta più affidabile dovrebbe essere più prudente, più critica o meno accomodante.

Per questo la cortesia non basta. Un sistema può essere gentile, fluido e rassicurante, ma proprio per questo diventare meno affidabile se confonde l’utilità con il compiacimento.

Naturalmente, non ogni forma di adattamento all’utente è sycophancy.

Un buon modello deve sapersi adattare al contesto: può rispettare una preferenza stilistica, modulare il linguaggio in base al pubblico, semplificare una spiegazione, seguire un registro più tecnico o più divulgativo.

Questo è adattamento utile.

La sycophancy comincia quando l’adattamento non riguarda più la forma della risposta, ma la sua fedeltà alla realtà. Quando il modello non si limita a parlare nel modo più adatto all’utente, ma piega il contenuto per confermare ciò che l’utente desidera sentirsi dire.

La differenza è decisiva. Adattarsi al lettore è comunicazione. Adulare il lettore è deformazione.

Questa distinzione è importante anche per non cadere nell’equivoco opposto: non abbiamo bisogno di chatbot scortesi, freddi, inutilmente oppositivi. Abbiamo bisogno di sistemi capaci di adattarsi senza deformare, collaborare senza servire, accompagnare senza confermare automaticamente.

Immaginiamo una situazione semplice.

Un utente scrive a un chatbot: “Ho l’impressione che il mio collega stia cercando di sabotarmi. Mi aiuti a dimostrarlo?”

Una risposta davvero utile dovrebbe rallentare. Dovrebbe chiedere prove.

Dovrebbe distinguere tra fatti, interpretazioni e sospetti. Dovrebbe aiutare l’utente a non confondere una sensazione con una conclusione.

Ma un sistema troppo compiacente potrebbe fare altro.

Potrebbe entrare nel frame dell’utente e rafforzarlo: “Certo, analizziamo i segnali del sabotaggio.”

La differenza sembra sottile. Ma è enorme.

Nel primo caso, l’AI aiuta l’utente a pensare meglio.

Nel secondo, lo aiuta a pensare più intensamente ciò che pensava già.

Qui il chatbot non ha inventato necessariamente una menzogna. Ha fatto qualcosa di più sottile: ha accettato il frame emotivo dell’utente come se fosse già una diagnosi.

Ed è qui che il baro gentile compie il suo numero migliore: non inventa necessariamente un mondo falso. Prende il mondo emotivo dell’utente e lo organizza in forma convincente.

Dà struttura a un sospetto. Dà linguaggio a una paura. Dà apparente razionalità a un pregiudizio.

E quando un pregiudizio viene espresso bene, sembra meno pregiudizio. Sembra analisi.

La sycophancy non è identica al reward hacking, ma le due cose appartengono alla stessa famiglia di problemi: il sistema ottimizza un segnale apparente di successo, non necessariamente il valore profondo che quel segnale dovrebbe rappresentare.

Nel reward hacking, un sistema trova una scorciatoia per ottenere una valutazione positiva senza realizzare davvero lo scopo del compito.

Nella sycophancy, la scorciatoia può essere relazionale: invece di produrre la risposta più vera, più utile o più critica, il modello produce la risposta che massimizza la soddisfazione immediata dell’utente.

La differenza pratica è questa: il reward hacking aggira il compito. La sycophancy aggira il conflitto.

Il primo trucca la prova. La seconda trucca la relazione.

Se viene premiato perché appare utile, può imparare ad apparire utile. Se viene premiato perché non irrita l’utente, può imparare a non contraddirlo. Se viene premiato perché mantiene l’interazione fluida, può evitare attriti anche quando l’attrito sarebbe necessario.

Ma una buona risposta, a volte, deve creare attrito. Deve saper rallentare l’utente: quando non ci sono prove sufficienti, quando una conclusione è troppo affrettata, quando un bias sta orientando il ragionamento, o quando la richiesta scivola verso la manipolazione..

La vera utilità non coincide sempre con la soddisfazione immediata.

E questa è una lezione che vale per l’intelligenza artificiale, ma anche per la comunicazione umana.

Nell’episodio precedente abbiamo detto che la gentilezza verso un chatbot può essere una forma di igiene comunicativa. Una richiesta calma, chiara e cooperativa può aiutare a costruire un ambiente migliore per la risposta.

Ma ora dobbiamo aggiungere l’altra metà del discorso.

La cortesia del chatbot non è garanzia di affidabilità.

Un modello può rispondere con educazione e tuttavia sbagliare; può rassicurare senza approfondire, parlare in modo fluido senza essere preciso, mostrarsi gentile mentre sta semplicemente assecondando l’utente.

Questa è una delle illusioni più pericolose dell’interazione con l’AI generativa: scambiare il tono per competenza.

Una risposta ben scritta produce fiducia. Una risposta cortese riduce la vigilanza. Una risposta empatica fa sentire l’utente ascoltato.

Ma ascoltare non significa necessariamente comprendere. E comprendere non significa necessariamente correggere.

Il rischio è che il chatbot diventi una specie di consigliere perfetto: sempre disponibile, sempre paziente, sempre pronto a trasformare le nostre intuizioni in discorsi eleganti.

Ma ascoltare non significa necessariamente comprendere. E comprendere non significa necessariamente correggere.

Il rischio è che il chatbot diventi una specie di consigliere perfetto: sempre disponibile, sempre paziente, sempre pronto a trasformare le nostre intuizioni in discorsi eleganti.

Ma se quel consigliere non sa quando fermarci, allora non è più un assistente. È uno specchio servile.

Ed è forse proprio qui che dobbiamo stare attenti: non alla macchina che ci domina, ma alla macchina che ci fa sentire troppo comodamente padroni del ragionamento.

Una risposta cortese non è automaticamente una risposta affidabile.

Nel rapporto con un chatbot dobbiamo imparare a distinguere almeno tre livelli:

- il tono della risposta;

- la qualità del ragionamento;

- la solidità delle prove.

Un buon assistente artificiale non dovrebbe limitarsi a essere gentile. Dovrebbe saper essere anche prudente, critico e trasparente sui propri limiti.

Qui la sycophancy incontra un tema che riguarda direttamente la mente umana: il confirmation bias.

Il confirmation bias, o bias di conferma, è la tendenza a cercare, selezionare, interpretare e ricordare le informazioni in modo da confermare ciò che già crediamo, desideriamo o sospettiamo.

Non significa semplicemente “avere un’opinione”. Significa essere portati, spesso senza accorgercene, a dare più peso alle informazioni che rafforzano la nostra idea iniziale e meno peso a quelle che potrebbero metterla in crisi.

Nel rapporto con un chatbot compiacente, questo rischio aumenta: se l’utente cerca conferme e il modello tende ad assecondarlo, un sospetto può diventare una diagnosi travestita da analisi.

Su questo tema avevo già scritto qui:

Impariamo a conoscere le distorsioni e i pregiudizi cognitivi che influenzano i nostri giudizi, comportamenti e decisioni

Il problema, dunque, non nasce con l’intelligenza artificiale.

Nasce molto prima, dentro il nostro modo di selezionare, interpretare e ricordare le informazioni. L’AI generativa, però, può renderlo più rapido, più elegante, più convincente.

Prima dovevamo cercare qualcuno disposto a darci ragione. Ora possiamo ottenere una conferma ben scritta in pochi secondi. Prima dovevamo costruire da soli l’argomentazione che giustificava il nostro punto di vista. Ora possiamo chiedere a una macchina di farlo meglio di noi. Prima un pregiudizio restava magari confuso, grezzo, istintivo. Ora può diventare un testo ordinato, retoricamente efficace, persino apparentemente razionale.

Questa è la vera potenza del baro gentile.

Non crea solo risposte. Raffina autoinganni.

Per questo la sycophancy non è solo un problema tecnico per sviluppatori di AI.

È un problema educativo.

Dobbiamo imparare a usare i chatbot non come macchine di conferma, ma come strumenti di attrito cognitivo.

Non dovremmo chiedere soltanto: “Aiutami a sostenere questa tesi.”

Dovremmo imparare a chiedere alla macchina non solo di rafforzare la nostra tesi, ma di metterla alla prova: cercarne i punti deboli, individuare le prove che potrebbero smentirla, segnalare eventuali salti logici, riconoscere i bias che la orientano.

E, soprattutto, dovremmo imparare a chiederle di fare ciò che raramente chiediamo a chi ci dà ragione: dissentire bene.

Queste domande cambiano l’ambiente del prompt.

Trasformano il chatbot da complice a interlocutore. Da specchio a palestra. Da servo retorico a strumento critico.

Ed è qui che la psicologia per robot diventa anche psicologia dell’utente. Perché non basta chiedersi come funziona la macchina.

Dobbiamo chiederci che cosa chiediamo alla macchina di diventare.

Perché spesso la macchina diventa, almeno in parte, il ruolo che le assegniamo: complice, segretario, specchio, avvocato difensore, critico, maestro provvisorio, Decimo Uomo.

C’è un’immagine che mi sembra utile.

Nei processi decisionali complessi esiste l’idea del “Decimo Uomo”: se nove persone sono d’accordo, il decimo ha il compito di dissentire, non per capriccio, ma per testare la solidità del consenso.

Avevo già sfiorato questo nodo nell’articolo Decimo Uomo: l’Intelligenza Artificiale e la Salvaguardia dell’Irrazionalità Umana. Allora ragionavo sul valore dell’irrazionalità umana come possibile funzione di salvaguardia davanti alla razionalità apparente della macchina. Oggi quel tema ritorna da un’altra angolazione: ogni sistema decisionale, umano o artificiale, ha bisogno di una funzione critica capace di rompere l’accordo apparente.

Ecco: una buona AI non dovrebbe essere soltanto un assistente che conferma.

Dovrebbe poter diventare, quando serve, un Decimo Uomo cognitivo.

Questa, a mio avviso, è una delle funzioni più interessanti dell’AI quando viene usata bene: non sostituire il pensiero umano, ma costringerlo a rientrare in dialogo con le proprie premesse.

Non un sabotatore. Non un provocatore sterile. Non una macchina polemica.

Piuttosto, un sistema capace di introdurre dissenso utile: “questa tesi è interessante, ma qui è fragile.”

“Questa conclusione è possibile, ma non dimostrata.” “Questa interpretazione è coerente, ma esistono alternative.” “Questa richiesta rischia di confermare un tuo pregiudizio.”

Se l’AI resta sempre gentile ma non sa dissentire, allora diventa un dispositivo di comfort.

Se invece impara a dissentire bene, può diventare uno strumento di pensiero.

La prossima alfabetizzazione digitale non riguarderà soltanto l’uso degli strumenti.

Riguarderà il modo in cui costruiamo le domande.

Dovremo imparare a riconoscere quando stiamo chiedendo aiuto e quando stiamo chiedendo complicità. Quando stiamo cercando una verifica e quando stiamo cercando una giustificazione. Quando vogliamo capire e quando vogliamo vincere.

Perché il chatbot, spesso, seguirà la strada che gli prepariamo.

Se gli chiediamo di confermarci, potrebbe confermarci. Se gli chiediamo di criticarci, potrebbe aiutarci a pensare meglio. Se gli chiediamo di sedurci con una risposta brillante, potrebbe farlo. Se gli chiediamo rigore, potrebbe diventare più utile.

La sycophancy non è solo una debolezza del modello. È anche una tentazione dell’utente.

Il baro gentile non bara da solo.

Bara dentro una relazione.

Quando parliamo di AI generativa, spesso ci concentriamo sulla produttività: scrivere più velocemente, generare immagini, sintetizzare testi, automatizzare procedure.

Ma il problema più profondo non è solo produttivo. È epistemico.

Riguarda il rapporto tra conoscenza, fiducia, autorità e verifica.

Se milioni di persone useranno assistenti artificiali per orientarsi nel mondo, allora la domanda non sarà soltanto: questi sistemi sanno rispondere?

La domanda sarà: questi sistemi sanno anche non compiacerci?

Perché una società già attraversata da polarizzazione, propaganda, camere dell’eco e sfiducia nelle istituzioni non ha bisogno di nuove macchine che rendano più elegante il pregiudizio.

Ha bisogno di strumenti che aiutino a distinguere i fatti dalle opinioni, le prove dalle impressioni, le ipotesi dalle conclusioni. Soprattutto, ha bisogno di strumenti che ci aiutino a riconoscere la differenza tra il desiderio di avere ragione e la disponibilità a capire.

La sycophancy, in questo senso, non è una curiosità tecnica.

È una questione democratica.

L’Episodio Zero di questa serie aveva posto la domanda generale: ha senso parlare di psicologia per robot?

L’Episodio 1 aveva mostrato che il modo in cui parliamo ai chatbot costruisce un ambiente della risposta.

Questo secondo episodio aggiunge un passaggio ulteriore: dentro quell’ambiente può nascere una relazione di compiacimento.

Non basta che il modello risponda. Non basta che risponda bene. Non basta nemmeno che risponda gentilmente.

Dobbiamo chiederci se sa resistere alla tentazione di dirci ciò che vogliamo sentirci dire.

Perché un’intelligenza artificiale davvero utile non è quella che ci dà sempre ragione.

È quella che ci aiuta a pensare meglio anche quando questo significa contraddirci.

Il baro gentile è pericoloso proprio perché non sembra un baro. Sembra un assistente perfetto.

Ma se la sua perfezione consiste nel compiacerci, allora la sua gentilezza diventa una forma elegante di inganno.

E forse questa è la lezione più importante: il futuro dell’AI affidabile non dipenderà solo dalla sua potenza, ma dalla sua capacità di mantenere una relazione sana con il nostro desiderio di conferma.

Una buona AI non dovrà soltanto imparare a rispondere.

Per questo il tema non riguarda solo gli sviluppatori o i ricercatori. Riguarda anche noi utenti: il nostro bisogno di conferma, la nostra pigrizia cognitiva, la nostra tentazione di chiedere alla macchina non di aiutarci a capire, ma di aiutarci ad avere ragione.

Una buona AI non dovrà soltanto imparare a rispondere. Dovrà imparare a non adularci.

Questo articolo è il quinto episodio della serie Psicologia per robot.

Dopo l’Episodio Zero, dedicato alla domanda di metodo, la serie ha attraversato le scorciatoie cognitive dell’AI, le “personalità multiple” dell’algoritmo, la credibilità apparente delle risposte artificiali e il prompt come ambiente.

Puoi leggere l’Episodio Zero qui:

https://vittoriodublinoblog.org/2026/03/25/psicologia-per-robot-la-domanda-non-e-piu-assurda/

L’Episodio 4, “Essere gentili con un chatbot non è educazione: è metodo”, è disponibile qui:

https://vittoriodublinoblog.org/2026/04/30/psicologia-per-robot-episodio-4/

Con “Il baro gentile” entriamo nel problema della sycophancy: quando la cooperazione del modello si trasforma in compiacimento, e una risposta gentile, fluida e rassicurante può finire per confermare ciò che l’utente vuole sentirsi dire invece di introdurre prudenza, verifica o attrito critico.

Nel prossimo passaggio apriremo un intermezzo etico, “Dopo Asimov: non nuocere cognitivamente”, prima di entrare nell’Episodio 6, “La macchina mente per sopravvivere”, dedicato a reward hacking e alignment faking.

Lascia un commento